Intégrez vos données depuis toutes vos sources

Extraire et charger en quelques minutes

Connectez-vous instantanément à des sources de données clés grâce à plus de 200 intégrations géréesCréez des pipelines de données avancés en quelques clics

Connectez toutes vos données

Ne laissez jamais de données derrière vous ! Connexion à n'importe quelle source grâce à l'API REST libre-serviceRéduisez vos coûts en utilisant une seule plateforme

Gérez en toute simplicité

Réduisez la maintenance ELT grâce aux intégrations gérées Bénéficiez d'une visibilité totale sur vos processus et coûts d'ingestion.

L'ingestion de données en toute transparence

Automatisez les pipelines de données en quelques minutes avec l'ingestion de données de Rivery

Réplication de données

- Répliquer des données en toute simplicité à partir de n’importe quelle base de données relationnelle ou NoSQL avec CDC (Change Data Capture)

- Réplication personnalisée de requêtes SQL (batch) pour les bases de données pour lesquelles le CDC n’est pas une option.

- Réplication rapide de volumes de données grâce aux chargements incrémentiels, au mappage automatique et à la gestion de la dérive des schémas.

Maîtrise du processus d'ingestion des données

- Utilisez, si vous le souhaitez, votre propre “landing zone”

- Sélectionnea des structures prédéfinies prêtes à être analysées ou des données brutes

- Contrôlez les données au niveau du champ et les colonnes calculées pour n’importe quel scénario

Plus de silos de données

- Orchestrez et surveillez les flux de travail ELT de bout en bout plutôt que de vous limiter à l’ingestion de données

- Configurez vos propres connexions personnalisées sans solutions externes

- Déclenchez un rafraîchissement des données dans Tableau/Power BI avec l’ETL inversé.

Antoine Lefebvre,

Product owner, chez Blablacar.

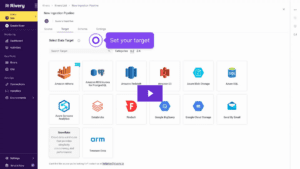

Comment cela fonctionne-t-il ?

1

Sélectionnez votre source parmi plus de 200 connecteurs ou configurez la vôtre.

2

Sélectionnez l’entrepôt ou le lac de données cible dans lequel les données seront intégrées.

3

Mappage automatique des champs, modification du schéma cible et définition du mode de chargement si nécessaire.

Rivery en action – Création d’une pipeline Salesforce vers Snowflake

FAQ

L’ingestion de données (également connue sous le nom de réplication de données dans le cloud ou d’extraction et de chargement) est le processus d’extraction de données à partir d’une source de données (base de données, application SaaS, fichiers, etc.) et de chargement dans un lac de données cible ou un entrepôt de données. Le processus d’ingestion peut être exécuté par batch, en temps réel ou en streaming.

L’ingestion de données est la partie extraction et chargement du processus ETL (extraction, transformation et chargement). Une fois les données ingérées dans votre lac ou entrepôt de données cible, vous devez les transformer pour qu’elles répondent à la stratégie opérationnelle. Remarque : l’ETL peut être réalisé en tant qu’ETL ou ELT, Rivery est un ELT. Pour en savoir plus, cliquez ici.

Oui, Rivery supporte à la fois la réplication CDC et batch ainsi que les capacités d’auto-migration pour effectuer automatiquement une migration complète de toutes les tables de données de la base en quelques clics. Pour en savoir plus sur les meilleures pratiques en matière de migration de données, cliquez ici.

Rivery offre plusieurs moyens d’automatiser le processus de réplication des données. Ceci inclut la possibilité de planifier un pipeline de données de la source à la cible en utilisant une sélection à partir d’une interface utilisateur ou en fournissant votre propre expression cron. Le pipeline peut également être programmé dans le cadre d’un flux de travail complet avec ses propres dépendances. Enfin, le pipeline peut être déclenché via une API ou dans le cadre d’un processus externe.

Une intégration API gérée (ou intégration de données automatisée) est une intégration pré-construite qui est conçue pour permettre une ingestion de données automatisée sans code via l’API source. Pour cette intégration de source gérée, Rivery est en charge de mettre à jour l’intégration de l’API.

L’ingestion de données est le point de départ de tout processus d’intégration de données. Les exemples les plus courants sont les suivants :

- Intégration des données d’une base de données opérationnelle telle que SQL Server ou PostgreSQL dans un espace de stockage ou un entrepôt de données dans le cloud.

- Chargement de fichiers à partir d’un espace de stockage tel que AWS S3 ou GCP Cloud Storage vers un entrepôt de données dans le cloud.

- Extraction et chargement de données à partir d’applications SaaS ou de toute API REST telle que Salesforce, Google Ads, Facebook Ads, Shopify et TikTok dans un entrepôt de données dans le cloud tel que Snowflake, BigQuery ou Databricks.

Réplication des données de n'importe quelle source vers n'importe quel lac ou entrepôt